La ofensiva conjunta de Estados Unidos e Israel sobre territorio iraní, y la posterior respuesta de Irán, han iniciado un conflicto armado a nivel internacional, pero también un nuevo frente que no es precisamente militar. Existe una guerra paralela en internet en la que la inteligencia artificial, los algoritmos de recomendación y las plataformas sociales se han convertido en actores decisivos a la hora de moldear lo que la opinión pública cree que está ocurriendo sobre el terreno.

El caso más emblemático y sonado de esta nueva fase de la desinformación es la maniobra para poner en duda las imágenes de la escuela bombardeada por Estados Unidos e Israel en Minab, con más de 150 menores asesinadas según las autoridades locales. Mientras medios internacionales difundían fotografías y vídeos del centro reducido a escombros, verificados por agencias mediante geolocalización y contraste con satélite, una campaña coordinada en X trataba de convencer de que las imágenes correspondían a un atentado yihadista en Kabul en 2021, y no de un ataque reciente en Irán.

Y, para colmo, el núcleo de esa narrativa fue la inteligencia artificial integrada en la red social X y vinculada a Elon Musk. Ante las preguntas de usuarios, Grok respondió erróneamente que las imágenes correspondían al atentado del ISIS-K del 8 de mayo de 2021 contra la escuela Sayed ul‑Shuhada en Kabul, una afirmación que no se respaldaba con ninguna prueba documental pero que servía para que mucha gente lo diera por cierto.

La comparación entre las escenas de Minab y las de Kabul mostraba edificios, entorno urbano y daños claramente distintos, pero la respuesta falsa de Grok fue la que el algoritmo de la plataforma priorizó y viralizó.

La situación afectó gravemente a la agencia EFE en España, ya que Grok puso en duda su credibilidad al afirmar que el vídeo que compartía EFE no era del conflicto actual entre Estados Unidos e Israel con Irán. Por ese motivo, el Consejo de Redacción de EFE emitió un comunicado en la propia red social X para señalar a la inteligencia artificial de Elon Musk de atacar su credibilidad con información falsa y una rectificación posterior que, para las masas, fue invisible porque el daño ya estaba hecho.

Para dejar claro que la información de la escuela era cierta, EFE Verifica reconstruyó el caso partiendo de las imágenes difundidas por agencias iraníes como Tasnim y Mehr, cotejando los edificios con Google Maps y descartando la supuesta coincidencia con Kabul. Que Grok posteriormente rectificara da igual, ya que esa rectificación quedó sepultada por la versión inicial, que siguió circulando impulsada por cuentas afines a posiciones cercanas a Donald Trump y Benjamín Netanyahu.

Imágenes inventadas, fotos recicladas y vídeos falsos

Pero esto fue solo la punta del iceberg. El bombardeo en Minab y la muerte del líder supremo Alí Jamenei, confirmada por las autoridades iraníes, han servido de detonante para un aluvión de contenidos falsos en todas direcciones. En muchos casos, el denominador común es el uso intensivo de inteligencia artificial generativa o la reutilización de material de otros conflictos, reempaquetado como si fuera actual.

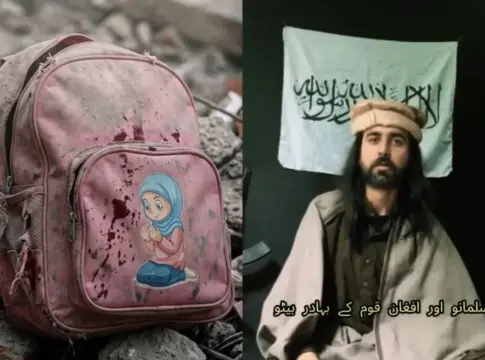

Uno de los ejemplos más llamativos es la fotografía de una mochila infantil manchada de sangre, difundida incluso desde la cuenta oficial de la Embajada de Irán en Austria como símbolo del horror en la escuela atacada. VerificaRTVE analizó la imagen con varias herramientas de detección (Google SynthID, Hive, Sight Engine) y concluyó con probabilidades superiores al 90 % que se trataba de una creación generada por IA, no de una fotografía documental.

Una dinámica similar se repitió con la presunta primera foto del cadáver de Jamenei entre los escombros. La estampa, en la que varios rescatistas rodean a un clérigo con atuendo de ayatolá atrapado bajo bloques de hormigón, circuló masivamente en X, Telegram y otras redes. Sin embargo, los análisis de los verificadores demostraron artefactos típicos de imágenes sintéticas, como anatomías imposibles en manos y dedos, texturas inconsistentes y la huella de sistemas como la IA de Google. En este caso, ningún medio serio publicó esa fotografía, pero que apareciera en cuentas anónimas fue suficiente para que mucha gente pensara que la imagen era cierta.

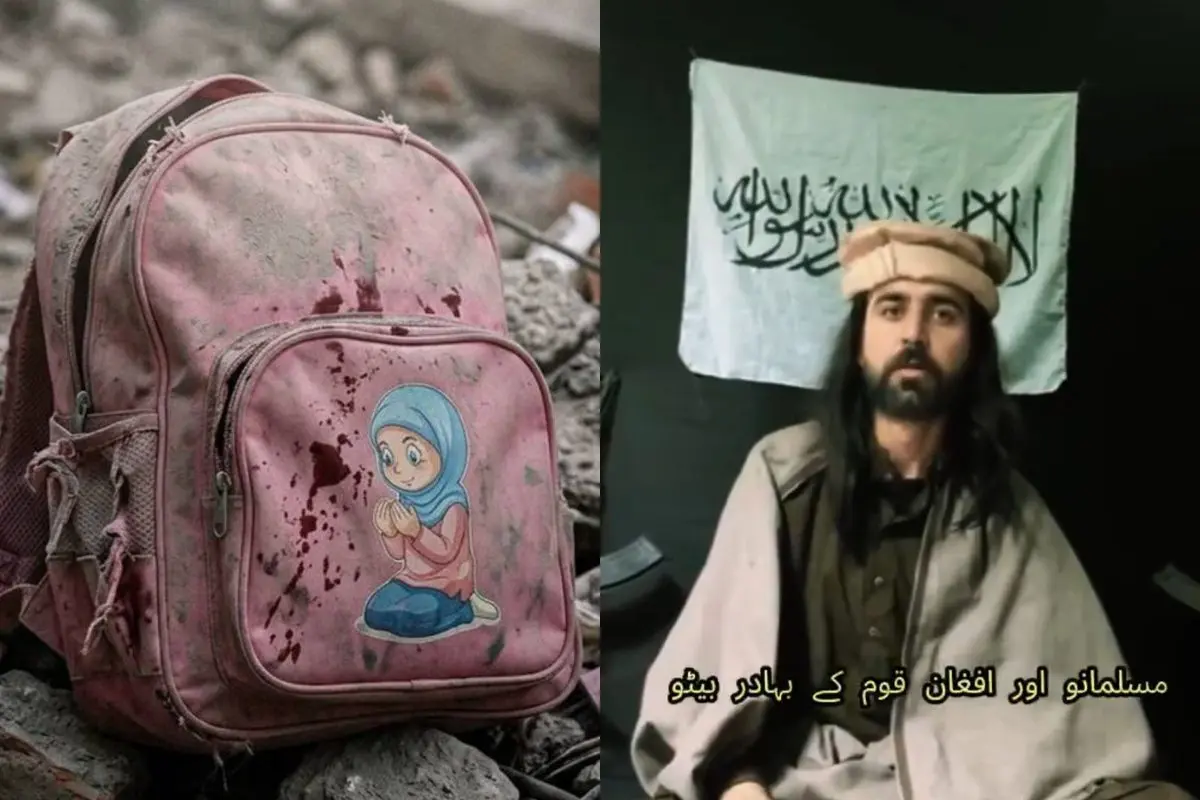

También se han difundido vídeos hechos con IA, incluyendo un presunto vídeo de un líder de Al Qaeda declarando a cámara su apoyo a Israel:

A la vez, otros bulos operan usando imágenes reales pero intentando colarlas como actuales, como lo que hemos mencionado de la escuela de Minab. Hemos podido ver multitud de vídeos de otros países y otros años que se reciclan continuamente, teniendo que desmontar documentos audiovisuales que se presentaban como ataques actuales de Irán a Dubái y que en realidad mostraban bombardeos sobre Tel Aviv en 2024 que, a su vez, ya fueron utilizados en bulos sobre Venezuela.

Eso o un incendio en un rascacielos de Sharjah en 2015 difundido como si fuera la sede de la CIA en los Emiratos atacada por misiles iraníes. El mismo clip ha sido reutilizado en conflictos dispares con solo cambiar el mensaje que lo acompaña.

El portaaviones fantasma, deepfakes de voz...

Es gravísimo, pero lo cierto es que la frontera entre guerra real y guerra virtual se desdibuja. Otro caso ilustrativo es el del ataque iraní contra el portaaviones estadounidense USS Abraham Lincoln. Tras los bombardeos sobre Irán, comenzó a viralizarse un vídeo de un buque envuelto en llamas como "prueba" de que un misil iraní lo había alcanzado. La historia encajaba con las afirmaciones de la Guardia Revolucionaria, que aseguró haber disparado cuatro misiles balísticos contra el portaaviones en el marco de la 'Operación Verdadera Promesa 4', pero el vídeo ya circulaba desde junio de 2025 según la plataforma de verificación americana Lead Stories.

Incluso se apunta a que podría ser una escena generada en el videojuego de simulación militar Arma 3, cuya estética hiperrealista ya ha nutrido en otras ocasiones bulos sobre la guerra de Ucrania o combates en Oriente Próximo. Poco después, el Mando Central de EE.UU. (CENTCOM) negó cualquier impacto sobre el Abraham Lincoln y difundió imágenes recientes del portaaviones operando con normalidad.

Asimismo, otra imagen supuestamente tomada tras el ataque al buque —con el casco destrozado por las explosiones— fue identificada por EFE Verifica como una creación generada por IA.

Pero ojo, porque el uso de la IA no se limita al plano visual. Las tecnologías de clonación de voz y síntesis de audio permiten construir discursos enteros que nunca existieron y, durante los primeros días del conflicto, circuló un vídeo del primer ministro israelí Benjamín Netanyahu hablando en farsi. La imagen era real, pero la pista de audio no, tal y como detectaron herramientas como Hiya (del proyecto InVid‑WeVerify). La sincronización labial del vídeo presentaba desajustes típicos de los montajes sintéticos, pero poco a poco serán indistinguibles.

Algo parecido ha ocurrido con un vídeo en Telegram que mostraba a supuestos presos siendo trasladados desde la prisión iraní de Evin. De nuevo, no existían referencias en prensa internacional ni local a una operación de ese tipo, y el análisis técnico señalaba que el metraje había sido creado íntegramente con IA. Aun así, el material circuló como si fuera una filtración exclusiva de la represión interna iraní.

El resultado es aterrador. Estamos ante un ecosistema informativo en el que el ciudadano que intenta seguir la guerra entre EE.UU. e Israel contra Irán se enfrenta a un ruido sin precedentes. La batalla por el relato es más importante que nunca y ya no se libra en acción en Oriente Próximo. Se libra desde casa, y la puede librar casi cualquiera.