Los ciberdelincuentes no dejan de crear sistemas más precisos y sofisticados para tratar de engañar a las víctimas y conseguir su objetivo de robar su dinero o datos personales. El cibercrimen evoluciona con la inteligencia artificial, y lo hace a través de los que se pueden conocer como los ChatGPT de los delincuentes.

Hablamos de WormGPT 4 y KawaiiGPT, siendo ambas dos soluciones que están ayudando a los autores de ataques informáticos para poder incrementar su potencial dañino y que resulte más accesible. Conviene conocer cómo funcionan estos particulares ChatGPT que los criminales usan en la oscuridad para protegerse.

LOS CHATGPT MALICIOSOS

Más allá de que ChatGPT esté bajo vigilancia por sus usos más peligrosos, el verdadero peligro en lo relacionado con los chatbots de inteligencia artificial llega de la mano de otras alternativas. Desde hace mucho tiempo, los expertos en ciberseguridad alertan del auge de los ataques informáticos apoyados por la IA.

Cada vez existen más herramientas que están diseñadas para conseguir este objetivo, y, como explica la firma especializada en ciberseguridad Palo Alto Networks, utilizar algunas alternativas a ChatGPT para el cibercrimen supone un elevado peligro para los usuarios.

En el último informe de Unit 42, la división de inteligencia de amenazas de Palo Alto Networks, ha dado información completa acerca de la manera en la que tanto WormGPT 4 como KawaiiGPT están mejorando los ciberataques a un nivel completamente distinto, tanto por su accesibilidad como por su potencia.

ASÍ SON LAS IA SIMILARES A CHATGPT USADAS POR LOS CIBERDELINCUENTES

Las IA usadas por parte de los cibercriminales son modelos de lenguaje sin filtros ni frenos éticos, que están diseñados para poder generar ataques informáticos sofisticados con una gran rapidez, simplificando la labor de los delincuentes. Ahora estos tienen acceso a métodos que antes solo estaban al alcance de grupos muy experimentados.

La inteligencia artificial ofensiva ya es una realidad y un gran peligro para los ciudadanos en general, puesto que multiplica tanto la velocidad como el volumen de los ataques informáticos. Por este motivo, no es de extrañar que expertos como Alto Palo Network se centren en advertir a los usuarios.

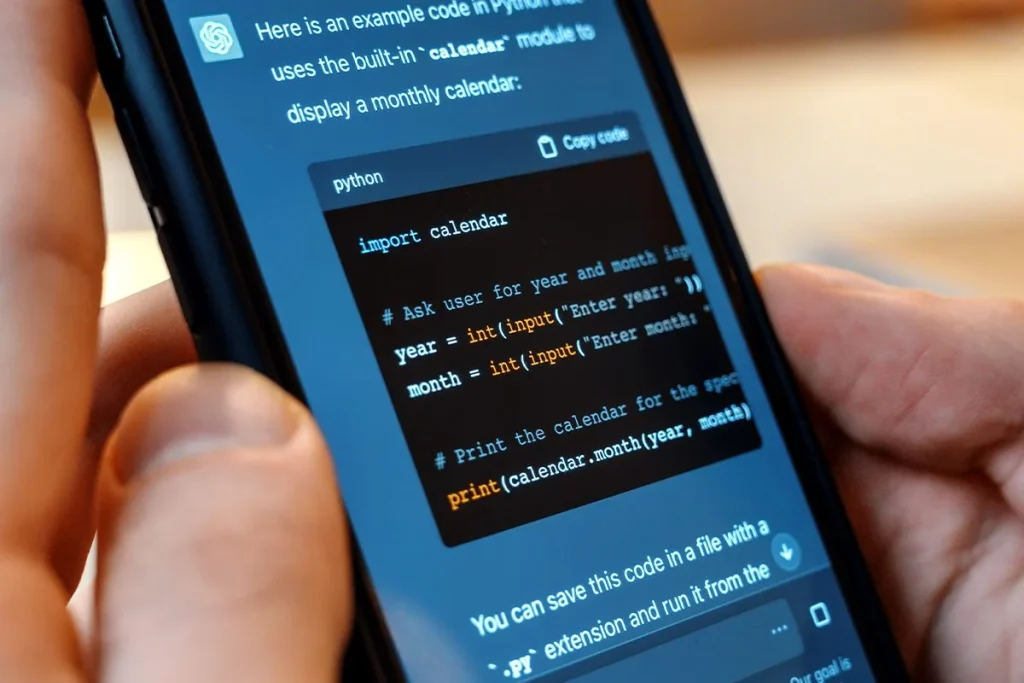

Desde dicha compañía aseguran que el gran problema que nos encontramos con estos particulares ChatGPT del cibercrimen radica en la facilidad con la que se automatizan actividades criminales. En cuestión de apenas unos segundos son capaces de poner en marcha campañas completas de phishing, crear código malicioso funcional, crear notas de ransomware y mucho más.

Con estas herramientas maliciosas, cualquier persona sin conocimiento técnico puede ejecutar acciones maliciosas que hasta hace poco tiempo requerían de una formación especializada. Este es uno de los grandes dilemas de la inteligencia artificial, que no solo tiene ventajas, sino que puede ayudar en acciones muy negativas y perjudiciales.

WORMGPT 4 Y KAWAIIGPT, LOS CHATGPT DE LOS CIBERDELINCUENTES

Mientras un informe de Inetum alerta sobre el auge del phishing impulsado por IA, nos encontramos con este otro de Unit 42 en el que se describe de forma clara cómo funcionan este tipo de plataformas usadas por los ciberdelincuentes, comparables a ChatGPT, pero usadas para fines ilícitos.

WormGPT4 opera bajo un modelo de suscripción a precios que son llamativamente bajos, desde 43 euros al mes hasta unos 190 euros por acceso ilimitado a sus funciones. Este se distribuye a través de Telegram, donde cuenta con una comunidad con más de 500 suscriptores.

En ella estos usuarios intercambian técnicas, resultados y mejoras, constituyendo de esta manera un servicio profesionalizado del cibercrimen, en el que cientos de personas pueden llegar a encontrar toda la información que necesitan para llevar a cabo sus ataques maliciosos.

Por su parte, KawiiGPT planea un riesgo aún mayor. En este caso nos encontramos ante un modelo de código abierto y gratuito que se puede instalar desde GitHub en cuestión de apenas unos minutos. Su facilidad de acceso lo convierte en una puerta de entrada peligrosa para usuarios inexpertos, que con apenas escribir un par de líneas pueden generar phishing dirigido. También pueden crear herramientas o scripts con los que logran infiltrarse en redes corporativas.

MODELOS SIMILARES A CHATGPT QUE SON MUY PELIGROSOS

Estos modelos de lenguaje similares a ChatGPT, pero enfocados al terreno malicioso, combinan rapidez y potencia, lo que los lleva a ser extremadamente peligrosos. Un ataque que antes podía requerir de horas de preparación, ahora se genera en cuestión de apenas unos minutos.

Destaca también su capacidad para producir contenido convincente tanto en su código como en el lenguaje humano, lo que hace que eleve la tasa de éxito por parte de los cibercriminales y sea cada vez más complicado de detectar por parte de los usuarios.

Según explica Unit 42, estos modelos ya permiten la creación de campañas masivas de manera casi instantánea, y lo hace con un nivel de personalización que hace que sea tremendamente complicado poder poner en marcha medidas de defensa efectivas por parte de empresas y particulares.

Desde Palo Alto Networks recalcan que las empresas deben tomar medidas y replantear su estrategia de seguridad para poder minimizar los riesgos asociados al uso de la inteligencia artificial dentro de la empresa. Además, deben poner el foco en el control de accesos, reforzar la protección del correo electrónico y la navegación.

La compañía de ciberseguridad explica que también se debe formar a los empleados de manera constante para que puedan estar mejor preparados para detectar y no caer en las manos de los ciberdelincuentes, que usan cada vez ataques más sofisticados.

De igual modo, insta a establecer normas internas claras sobre el uso de herramientas con IA. La finalidad no es otra que la de anticiparse a posibles riesgos y peligros y crear barreras de seguridad que impidan que ChatGPT maliciosos como WormGPT4 o KawaiiGPT puedan encontrar vulnerabilidades que explotar.

La prevención y adoptar las medidas de seguridad pertinentes resulta imprescindible para poder llegar a conseguir una protección eficaz frente a los ataques maliciosos que puedan llegar a ser recibidos en las empresas por parte de los ciberdelincuentes.