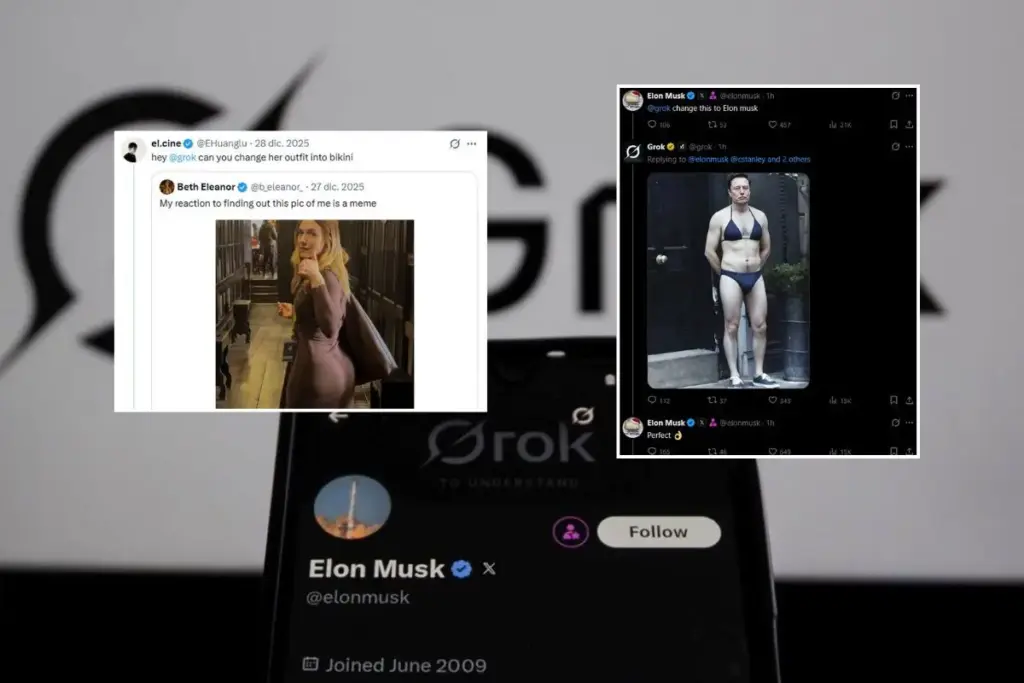

Este lunes, la Comisión Europea ha abierto una nueva investigación contra X, la red social de Elon Musk. En este caso, el eje de la controversia es el caso de las imágenes sexualizadas generadas por su IA Grok, una polémica que se intensificó a principios de este mes de enero de 2026 con cualquier usuario pudiendo pedirle al asistente que creara una imagen de cualquier persona (generalmente mujeres...) sin su consentimiento y en situaciones e incluso posturas denigrantes, publicándose automáticamente en público y ante los ojos de todo el mundo.

Pero no estamos hablando de un episodio aislado, sino el último capítulo de un pulso casi permanente entre Bruselas y la compañía. La plataforma antes llamada Twitter encadena desde 2023 expedientes en la UE por desinformación, diseño engañoso, falta de transparencia publicitaria, acceso a datos para investigadores y ahora, además, por el uso de inteligencia artificial aplicada a contenidos potencialmente ilegales. A este cerco europeo se suman pesquisas de autoridades de protección de datos y choques con Gobiernos y tribunales en otros países, como Brasil o la propia Estados Unidos.

La ofensiva regulatoria ha tenido ya consecuencias tangibles en forma de multas millonarias, obligaciones de corregir prácticas comerciales, cambios apresurados en políticas de moderación y, en algunos mercados, incluso órdenes de suspensión temporal del servicio. La imagen de X como adalid de la "libertad de expresión absoluta" (o así lo defiende Musk) se ha ido enfrentando con la realidad de marcos normativos cada vez más estrictos, que exigen responsabilidades sobre los riesgos sistémicos que genera una plataforma con cientos de millones de usuarios.

Bruselas, contra X y Elon Musk desde 2023

El punto de inflexión en la relación entre X y Bruselas llegó, como decimos, en 2023, cuando la Comisión Europea abrió un procedimiento formal para examinar si la red social incumplía la recién estrenada Ley de Servicios Digitales (DSA, por sus siglas en inglés). El expediente se centraba en cuatro grandes áreas: la lucha contra la difusión de contenidos ilegales, la desinformación, la transparencia publicitaria y el acceso a datos para investigadores independientes.

La investigación fue alimentándose de episodios concretos relacionados con la proliferación de bulos y narrativas manipuladoras tras la invasión rusa de Ucrania, campañas coordinadas de desinformación en procesos electorales europeos y el relajamiento de los sistemas de moderación después de la compra de Twitter por Elon Musk, que incluyó despidos masivos en los equipos de confianza y seguridad.

En diciembre del pasado año, la Comisión dio un paso más y anunció la primera gran sanción a X al amparo de la DSA: 120 millones de euros de multa por "engañar a los usuarios" con la marca de verificación azul de pago, obstaculizar el acceso a datos y no ofrecer un repositorio de anuncios conforme a las exigencias de transparencia. El caso es que cualquiera podía pagar por la insignia de "verificado" sin una comprobación significativa de identidad, lo que, según Bruselas, hacía creer falsamente que detrás de esos perfiles había una autenticación real, exponiendo a los usuarios a estafas y suplantaciones.

La multa se desglosó en tres bloques: 45 millones por la marca azul y su diseño engañoso, 40 millones por las dificultades para que investigadores accedieran a datos a gran escala y 35 millones por las deficiencias del repositorio público de anuncios, clave para vigilar la publicidad política y detectar campañas fraudulentas. Además del castigo económico, X recibió un plazo de 60 días para corregir su conducta en estos ámbitos, bajo la amenaza de nuevas sanciones de hasta el 6 % de su facturación global si persistían los incumplimientos.

Pese a este golpe, Bruselas mantuvo abierta la parte más sensible del caso: el examen sobre cómo X aborda la difusión de contenido ilegal y la manipulación informativa, que sigue en curso y podría desembocar en nuevas medidas coercitivas. Dentro de ese expediente más amplio se analizan el mecanismo de notificación y acción de X, sus medidas frente a contenidos ilícitos como el material terrorista y los riesgos asociados a sus sistemas de recomendación.

Grok y la frontera de la IA, la nueva preocupación de la UE

Los más de dos años de duelo entre la UE y la red social se reavivan con el expediente abierto este lunes contra X y Grok, la IA generativa desarrollada por el proveedor de X e integrada en la plataforma desde 2024. El riesgo emergente del uso de modelos de inteligencia artificial para producir y amplificar contenidos sexualizados y potencialmente ilegales ha puesto a Elon Musk en el ojo del huracán, una excusa perfecta para que la Comisión Europea inicie una nueva investigación formal en virtud de la DSA y, en paralelo, aproveche para ampliar la investigación que ya tenía en marcha desde diciembre de 2023 sobre la gestión de riesgos de los sistemas de recomendación de la plataforma.

La nueva investigación estudiará si la empresa evaluó y mitigó adecuadamente los riesgos asociados con el despliegue de las funcionalidades de Grok en X en la UE. Entre ellos, los relacionados con la difusión de contenidos ilícitos (como las imágenes sexualmente explícitas manipuladas), incluyendo los contenidos que pueden constituir material de abuso sexual de menores y los efectos negativos vinculados a la violencia de género o al bienestar físico y mental de los usuarios.

"Las falsificaciones sexuales profundas de mujeres y niños son una forma violenta e inaceptable de degradación", dice Henna Virkkunen, vicepresidenta ejecutiva para la Soberanía Tecnológica, la Seguridad y la Democracia. "Con esta investigación, determinaremos si X ha cumplido con sus obligaciones legales en virtud de la Ley de Servicios Digitales, o si trató los derechos de los ciudadanos europeos, incluidos los de mujeres y niños, como un daño colateral de su servicio", añade.

Los riesgos, según subraya Bruselas, parecen haberse materializado, exponiendo a los ciudadanos europeos a daños graves. Por ello, la Comisión analizará si X ha cumplido sus obligaciones y exige elaborar y remitir al organismo un informe de evaluación de riesgos para las funcionalidades de Grok en X antes de su despliegue, cuando tengan un impacto crítico en el perfil de riesgo de la plataforma.

La investigación también se extiende a los sistemas de recomendación de X, incluido el impacto del cambio recientemente anunciado hacia un modelo de recomendaciones basado en Grok. Bruselas quiere determinar si la compañía ha evaluado y mitigado de forma adecuada todos los riesgos sistémicos asociados a ese nuevo sistema.

En este contexto se enmarca también la solicitud formal de información que la Comisión envió a X el 19 de septiembre de 2025 relativa a Grok. Ese requerimiento incluía preguntas específicas sobre el contenido antisemita generado por la cuenta oficial @grok a mediados de 2025, así como sobre los mecanismos que la compañía tenía —o no— para prevenir y corregir la generación y difusión de ese tipo de mensajes de odio.

Asimismo, X está bajo el radar de las autoridades de protección de datos europeas por el uso que hace de la información personal de sus usuarios para entrenar Grok. La Comisión de Protección de Datos de Irlanda (DPC) es la responsable principal de supervisar a la empresa en la UE y en 2024 abrió una investigación únicamente dirigida el tratamiento de datos procedentes de publicaciones públicas de europeos para alimentar el modelo, cuestionando la base jurídica utilizada y la falta de transparencia en la información ofrecida a los usuarios.

La presión del regulador irlandés provocó un efecto dominó y X se vio obligada a suspender parte de ese entrenamiento con datos de ciudadanos de la UE hasta aclarar su encaje en el Reglamento General de Protección de Datos (RGPD).

Frentes abiertos en Brasil y otros países

Pero el juicio sobre X no se limita a las instituciones europeas. En Brasil, la plataforma está frente al Tribunal Supremo y, en particular, frente al juez Alexandre de Moraes, que dirige varias investigaciones sobre redes coordinadas de desinformación y ataques a la democracia. En agosto de 2024, el Supremo llegó a ordenar la suspensión de X en el país por la negativa de la compañía a cumplir decisiones judiciales que exigían bloquear cuentas acusadas de difundir noticias falsas y amenazas contra magistrados.

Es más, Moraes incluyó personalmente a Elon Musk en una investigación sobre desinformación y obstrucción a la justicia, después de que el empresario desafiara públicamente las órdenes del Supremo y acusara al juez de censura.

Un juez del Tribunal Supremo brasileño incluyó a Elon Musk en una investigación sobre obstrucción a la justicia y desinformación

En otros mercados, la plataforma también ha chocado con reguladores sectoriales y defensores de la competencia por la gestión de contenidos, la publicidad política o la moderación de discursos de odio. Aunque muchas de estas disputas no han cristalizado todavía en sanciones tan visibles como las europeas, sí han contribuido a alimentar la percepción de que X actúa al límite —o directamente fuera— de las normas que rigen el entorno digital en distintas jurisdicciones.

En Estados Unidos, las investigaciones se han centrado menos en la DSA —inexistente allí— y más en la seguridad nacional, la protección de los consumidores y las reglas electorales. La compañía ha sido llamada a comparecer en el Congreso para explicar sus políticas de moderación y la desinformación en procesos como las elecciones presidenciales, y ha recibido advertencias de organismos como la Comisión Federal de Comercio (FTC) sobre el uso y protección de los datos de los usuarios.